Instituto del Derecho de las Telecomunicaciones

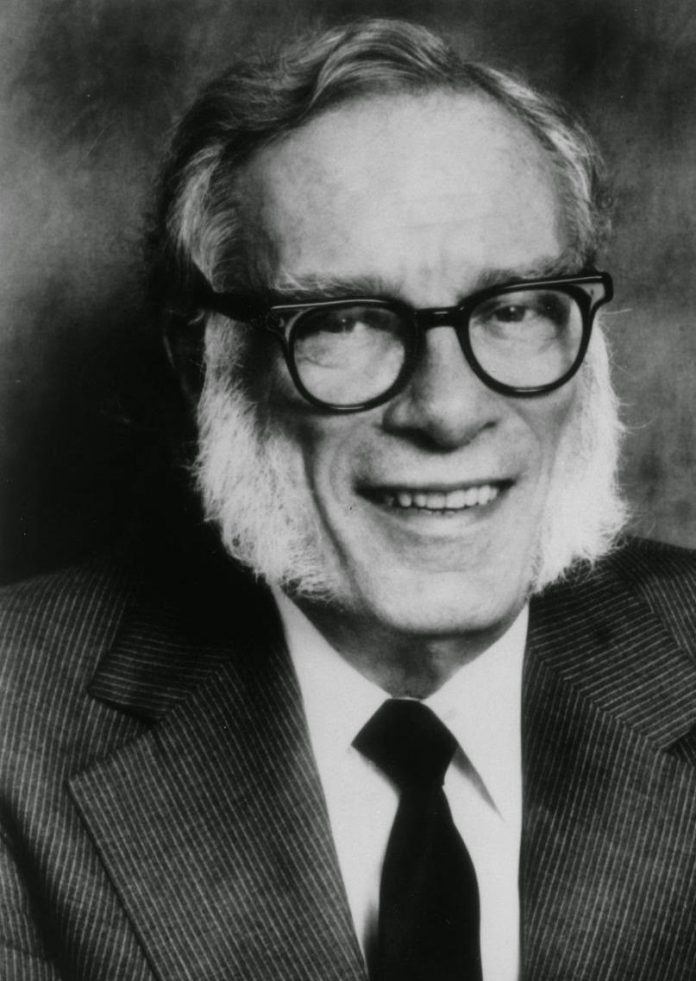

Ciudad de México, 9 de enero de 2020.- El pasado 2 de enero se celebró el centenario del nacimiento de uno de los escritores más prolíficos de la ciencia ficción: Isaac Asimov.

Nacido en la Unión Soviética, pero criado en los Estados Unidos, escribió más de medio millar de libros en géneros tan distintos como la novela de misterio (Murder at The ABA), la divulgación científica (The Living River) y, por supuesto, la ciencia ficción con series como la Fundación, una de las sagas de ciencia ficción más ambiciosas: siete volúmenes que narran un milenio en el futuro de la humanidad esparcida por la Vía Láctea.

A diferencia de otros escritores concentrados en describir naves espaciales, planetas lejanos y seres extraterrestres, Asimov se dedicó a reflexionar sobre el efecto que diversas tecnologías tendrían en la vida de los seres humanos tanto a nivel social como individual. Algunas de sus preocupaciones y planteamientos adquieren creciente vigencia a medida que los mundos que describió comienzan a volverse realidad.

La inteligencia artificial (IA) y la ética: en 1942 Asimov escribió un cuento titulado “Sentido giratorio”, donde aparecen por primera vez sus leyes de la robótica, que definen la conducta de las máquinas respecto de los humanos. Estas leyes, insertadas en cada robot evitan que sean usados como armas o incurran en conductas dañinas para los humanos.

En los últimos años han aparecido iniciativas como la Global Initiative on Ethics of Autonomous and Intelligent Systems y la Partnership on AI que buscan agrupar a fabricantes, académicos, gobiernos y miembros de la sociedad civil para definir reglas que impidan el uso de la inteligencia artificial y la robótica con fines nocivos.

El problema es que robots dotados de armas ya están en avanzadas fases de desarrollo junto con sistemas de IA cuya finalidad es destruir al enemigo, humanos incluidos.

Adicción a lo digital: En el cuento “Encajar perfectamente”, publicado en 1981, Ian Bradstone es un hacker castigado por un intento de robo informático hacia un banco con un tratamiento que le hace padecer un severo malestar físico cuando se acerca a un dispositivo digital. En una sociedad donde toda interacción, incluyendo transacciones comerciales, requieren el procesamiento de datos, Bradstone se encuentra al borde de la desesperación al no poder siquiera comprar un bocadillo para saciar su hambre.

En una extraña vuelta de tuerca, China es quizá el primer país que considera que la adicción a la tecnología es un problema que debe ser tratado con mano dura. En 2008, el país reconoció la adicción digital como un problema psicológico y años más tarde comenzaron a operar “clínicas” dedicadas a rehabilitar a personas adictas a la tecnología, usando herramientas que van de la psicoterapia a la severa disciplina militar.

Tecnología predictiva: En su novela “Fundación”, publicado en 1950, un científico llamado Hari Seldon crea una ciencia llamada psicohistoria que le permite conocer con anticipación hechos que ocurrirán en el futuro. Con esta ciencia, Seldon determina que la humanidad experimentará un declive por 30 mil años que podrá acortarse hasta un milenio tomando algunas decisiones como la creación de una colonia de científicos llamada Fundación, en el borde de la Vía Láctea.

El avance en las técnicas de análisis de grandes cantidades de datos (big data) y el uso de poderosos sistemas de aprendizaje automatizado (machine learning) han habilitado el crecimiento de una ciencia llamada análisis predictivo, que permite realizar previsiones en temas como la detección temprana de fraudes financieros, por ejemplo.

El problema de la caja negra: En su novela Yo, robot, el escritor narró en 1950 que hacia inicios del siglo XXI un tal Robertson creó una tecnología capaz de crear cerebros artificiales dotados con inteligencia artificial. Dichos cerebros toman paulatino control de una creciente cantidad de actividades humanas hasta dominar el funcionamiento de la economía humana en beneficio de sus creadores, puesto que, bajo la primera ley de la robótica, ningún robot puede dañar a un ser humano o permitir que un ser humano sea dañado. Sin embargo, hay un problema: nadie puede saber cómo toman decisiones los robots.

Este es un problema actual en la inteligencia artificial (IA). Los sistemas de aprendizaje automatizado poseen enormes capacidades para analizar datos, detectar patrones y tomar decisiones, pero los científicos que las diseñan se han encontrado con que los sistemas de IA son incapaces de explicar las razones por las que tomaron dicha decisión. Este problema, llamado “caja negra” tiene enormes implicaciones puesto que decisiones legales y comerciales entre humanos están sujetos a procesos de revisión y apelación. ¿Qué pasa cuando una máquina no puede explicar los motivos de su decisión?